深度学习(Deep Learning)是机器学习的一个分支,它通过构建具有多个处理层(即“深度”)的神经网络模型,自动从数据中学习层次化的特征表示。自2006年左右兴起以来,深度学习已成为推动人工智能(AI)领域发展的核心技术,在计算机视觉、自然语言处理、语音识别等多个方向取得了突破性进展。

深度学习是什么?

从技术范畴上看,深度学习是表征学习(Representation Learning)的一种,而表征学习又是机器学习的一种方法。机器学习则是实现人工智能的途径之一。因此,深度学习、机器学习、人工智能是层层包含的关系。

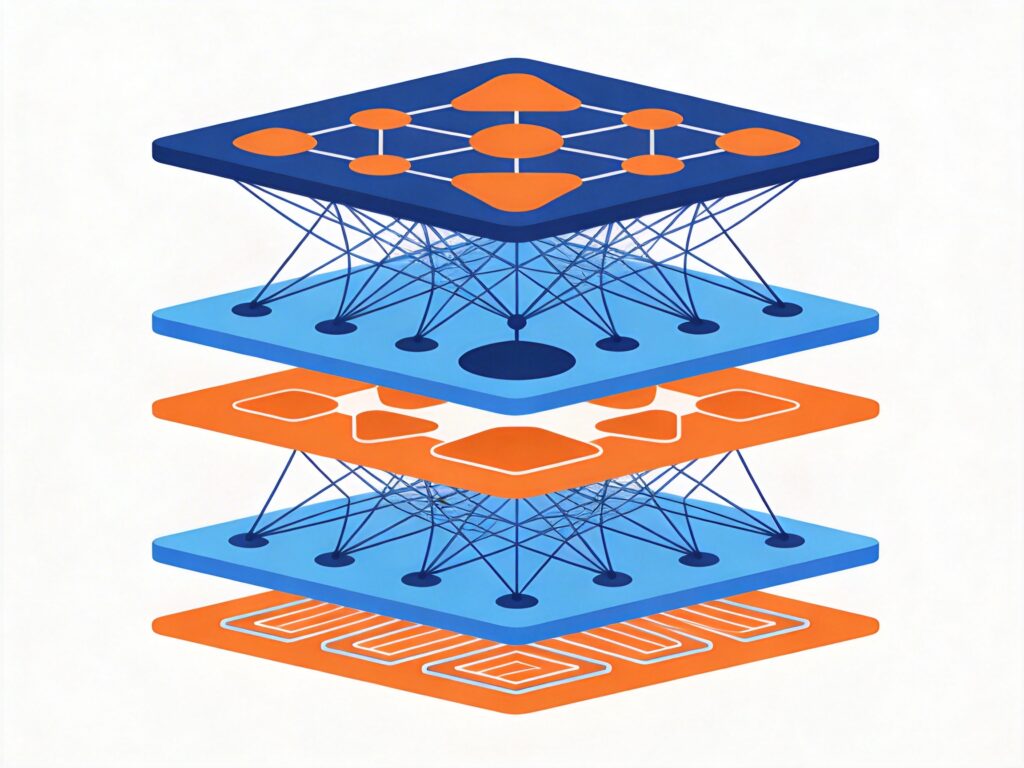

深度学习模型的核心在于其“深度”结构。模型通过多层非线性变换,逐层从原始输入数据中提取并组合特征。浅层网络通常学习到的是边缘、颜色等简单特征,而深层网络则能组合这些简单特征,形成更抽象、更高级的概念(如物体部件、整体形状等)。这种自动学习特征的能力,使其区别于需要人工设计特征的传统机器学习方法。

关于“深度”的理解,主要有两种观点:一是计算图的深度,即从输入到输出所需计算步骤的长度;二是概念层次结构的深度,即模型所表达的特征抽象层级。这两种视角共同揭示了深度学习通过多层次非线性变换逼近复杂函数的能力。

常见模型

深度学习框架下包含多种具体模型,以下是几种经典类型:

多层感知机(MLP)

MLP是最基础的深度前馈神经网络,由输入层、多个隐藏层和输出层组成,层间全连接。它通过激活函数引入非线性,能够解决感知机无法处理的非线性问题(如异或XOR)。训练通常采用反向传播(BP)算法结合梯度下降优化参数。

深度信念网络(DBN)与深度玻尔兹曼机(DBM)

两者都是基于受限玻尔兹曼机(RBM)堆叠而成的生成式模型。DBN通常采用逐层贪婪预训练策略,层间连接多为有向;而DBM中所有相邻层间的连接都是无向的。它们为深度模型的训练提供了有效的初始化方法。

卷积神经网络(CNN)

CNN专为处理网格状数据(如图像)设计,其核心是卷积层和池化层。卷积操作通过权值共享大幅减少参数量,池化则提供空间不变性。从LeNet到ResNet,CNN的结构不断加深和优化,成为计算机视觉领域的基石模型。

循环神经网络(RNN)与长短期记忆网络(LSTM)

RNN专为处理序列数据设计,其隐藏状态能够传递历史信息,从而建模序列间的依赖关系。LSTM是RNN的一种重要变体,通过引入“门”机制(输入门、遗忘门、输出门)和细胞状态,有效缓解了原始RNN的梯度消失/爆炸问题,使其能够学习长程依赖关系。

深度自编码器(Deep Autoencoder)

自编码器是一种无监督学习模型,旨在学习输入数据的高效编码(即表征)。其目标是通过编码器和解码器重构输入,迫使中间层的编码捕获数据的关键特征。深度自编码器通过堆叠多层隐层,可以学习更复杂的特征,常用于降维、去噪和特征提取。

深度网络的优化方法

训练深度网络需要高效的优化算法来最小化损失函数。以下是一些常用优化器:

- 随机梯度下降(SGD):每次更新基于一个或一小批(mini-batch)样本的梯度。简单有效,但可能收敛慢且易震荡。

- 自适应优化器:这类方法为每个参数自适应地调整学习率。

- Adagrad:为稀疏特征设置较大的学习率,但累积梯度平方会导致学习率过早衰减。

- Adadelta / RMSprop:改进了Adagrad,使用滑动窗口平均梯度平方,缓解学习率衰减过快问题。

- Adam:结合了动量(一阶矩)和RMSprop(二阶矩)的思想,通常收敛速度快且稳定,是当前最常用的优化器之一。

- Adam变体:如Adamax、Nadam等,在Adam基础上做了进一步改进。

深度网络中常用的技术

为防止过拟合、加速训练并提升模型稳定性,实践中常采用以下技术:

- 反向传播(BP)与激活函数:BP是训练神经网络的核心算法。激活函数(如ReLU、Sigmoid、Tanh)引入非线性,其选择影响梯度流动和模型表达能力。ReLU及其变体(如Leaky ReLU)因能缓解梯度消失问题而被广泛使用。

- 丢弃法(Dropout):在训练过程中随机“关闭”一部分神经元,强制网络学习更鲁棒的特征,是一种有效的正则化手段。

- 批量归一化(Batch Normalization):对每层的输入进行归一化处理,稳定数据分布,允许使用更大的学习率,加速训练并降低对初始化的敏感度。

- 早停法(Early Stopping):在验证集性能不再提升时终止训练,防止过拟合。

- 正则化:在损失函数中加入L1或L2范数惩罚项,约束权重的大小,提高模型泛化能力。

深度学习常见的实现平台和框架

选择合适的框架能极大提升开发效率。以下是一些主流选择:

- TensorFlow / PyTorch:当前最流行的两大框架。TensorFlow生态庞大,生产部署成熟;PyTorch动态图机制更灵活,深受研究人员喜爱。

- Keras:一个高层API,最初基于TensorFlow/Theano,现已成为TensorFlow的一部分。它接口简洁,能快速构建原型。

- 其他框架:

- Caffe:早期专注于计算机视觉,速度快,但扩展性较差,已逐渐被取代。

- MXNet:高效灵活,支持多语言,被亚马逊AWS采用。

- CNTK:微软推出的框架,在语音任务上表现优异。

- Deeplearning4j (DL4J):基于Java的商用级框架,易于与Hadoop/Spark集成。

深度学习网络实例

一系列经典的CNN架构推动了计算机视觉的发展:

- LeNet-5:由Yann LeCun提出,用于手写数字识别,奠定了CNN“卷积-池化-全连接”的基本结构。

- AlexNet:在2012年ImageNet竞赛中一战成名,首次在大规模图像分类中证明深度CNN的威力,采用了ReLU、Dropout等技术。

- VGGNet:通过反复堆叠3x3小卷积核和2x2池化层,构建了16-19层的均匀网络,结构简洁有效。

- GoogLeNet:引入Inception模块,在层内并行多尺度卷积与池化,大幅提升特征提取能力,同时控制了参数量。

- ResNet:通过残差连接(跳跃连接)解决了极深网络(如152层)的梯度消失和退化问题,使训练数百甚至上千层的网络成为可能。

深度学习的应用

深度学习已渗透到AI的各个应用领域:

- 计算机视觉:图像分类、目标检测、语义分割、图像生成、视频分析等。

- 语音识别:将音频信号转化为文字,是智能助手(如Siri、小爱同学)的核心技术。

- 自然语言处理:机器翻译、文本分类、情感分析、智能问答、文本生成等。

- 推荐系统:利用用户行为数据,进行个性化内容、商品或广告推荐。

深度学习延伸

随着基础技术的成熟,一些更高级的学习范式与深度学习结合,拓展了其边界:

- 迁移学习:将在源任务上训练好的模型(或部分层)的知识,迁移到目标任务上,尤其适用于目标领域数据稀缺的场景。

- 强化学习:智能体通过与环境交互,以“试错”方式学习最优策略。深度强化学习(如DQN、AlphaGo)将深度神经网络作为函数近似器,在游戏、机器人控制等领域取得瞩目成就。

- 生成对抗网络:通过生成器与判别器的对抗博弈,学习生成逼真的数据(如图像、音频、文本),在内容生成、数据增强等方面应用广泛。

学习资源

若想系统学习深度学习,以下资源可供参考:

在线课程

- 斯坦福 CS231n: Convolutional Neural Networks for Visual Recognition

- 斯坦福 CS224n: Natural Language Processing with Deep Learning

- Deep Learning Specialization (Coursera, by Andrew Ng)

- Fast.ai: Practical Deep Learning for Coders

经典书籍与资料

- Deep Learning (Ian Goodfellow, Yoshua Bengio, Aaron Courville) – 被誉为“花书”

- Neural Networks and Deep Learning (Michael Nielsen) – 在线免费书籍

- 各主流框架(TensorFlow, PyTorch)官方文档与教程

社区与会议

- 会议: NeurIPS, ICML, ICLR, CVPR, ACL

- 期刊: JMLR, IEEE TPAMI

- 社区: arXiv, Papers with Code, GitHub

深度学习领域发展迅速,保持学习的最佳方式是动手实践,参与开源项目,并持续关注前沿研究。